Klickedicklick – Klickediklack. Ratter, ratter, ratter. Das war der Klang von tausenden Tastaturen, kurz bevor im Januar 2023 alle Timelines dieser Welt mit Artikeln und Tutorials zu ChatGPT geflutet wurden. Das passiert, wenn ein Chatbot das Thema Künstliche Intelligenz aus der Theorie in die Praxis holt. Und das schlagartig für viele Menschen: Im Januar erreichte ChatGPT über 100 Millionen Nutzer. Damit ist es die am schnellsten wachsende Verbraucheranwendung aller Zeiten.

Interessant an ChatGPT und anderen Anwendungen ist dabei jedoch nicht nur der Nutzen ad hoc. Die meisten Privatpersonen nutzen ChatGPT, um Fragen zu beantworten, Übersetzungen durchzuführen und Informationen zu suchen.

Spannend ist, welche Auswirkungen die Anwendungen kurz-, mittel- und langfristig auf unsere Lebensbereiche wie Schule und Universitäten sowie die Arbeit hat. Dazu gehört im besonderen Maße das Kommunikations-Business und deren Berufe.

Generative KI – ein „wake up call” für die Kommunikationsbranche?

Das Thema wird in der Kommunikationsbranche heiß geliebt und zugleich argwöhnisch beäugt. Denn die Implikationen für die tägliche Arbeit durch generative KI – könn(t)en – fundamental sein. Dabei schwankt die Bandbreite derzeit von einfachen Textaufgaben bis hin zum Blogartikel auf Knopfdruck. Da sieht manche:r in Zukunft die Relevanz der eigenen Produktionsmittel infrage gestellt.

Werden Content- und Mediabusiness jetzt durchgerüttelt? Auf jeden Fall. Die Hürden, publikationsfähige Inhalte zu erstellen, sind wieder einmal gesunken. Aber wäre es so schlimm, wenn wir künftig nicht mehr nach WDF-IDF für etliche Kategorieseiten suchmaschinenoptimierte Texte schreiben oder den dreitausendsten Infokasten zu einem Thema in einem Artikel verfassen? Wäre es nicht sinnvoller, mehr Zeit darin zu investieren, mit Menschen über spannende Themen zu sprechen und deren Perspektiven nahbar zu machen?

Die technische Singularität lässt auf sich warten

Die Zweifel, dass es mit der maschinellen Inhaltserstellung so reibungslos läuft, wie uns das die ganzen „Expert | Founder | 🚀🚀🚀“ auf LinkedIn glauben machen wollen, sind mehr als berechtigt. Hochwertige Publizistik auf Speed wird so nicht funktionieren. Generative KIs wie Chat GPT verstehen den Output nicht, den sie generieren. Genauso wenig, wie sie die Bedeutung von dem verstehen, was wir so in unsere Prompts tippen. Das Intelligente an ihnen ist die Fähigkeit, in Fragmente zerlegte Sprache mithilfe statistischer Berechnungen so zusammenzusetzen, dass sie dem Prompt möglichst nahekommt und wir zufrieden mit dem Ergebnis sind. Semantik und Statistik. Sophisticated, yes, aber am Ende halt 1 und 0.

“[ChatGPT] doesn’t know how to separate fact from fiction.[…] It definitely can’t do the job of a journalist. To say so diminishes the act of journalism itself.“

Jackson Ryan, Journalist

Das wird besonders dann deutlich, wenn wir Inhalte und Ideen haben wollen, die besonders sind. Oder über die bisher niemand berichtet oder gesprochen hat. Dinge, die uns etwas Neues erzählen, einen neuen oder anderen Blick auf die Welt ermöglichen. In einem öffentlichen Feldversuch konnte das US-Technikmagazin CNET bereits (unfreiwillig?) zeigen, dass wir den Inhalten, die die generativen Modelle erstellen, nicht ohne Weiteres trauen können.

Der dänische Media-Analyst Thomas Baekdal zog hierzu bereits im Januar ein eher verhaltenes Fazit: wer wirklich professionelle Inhalte erstellt, mit Menschen spricht, recherchiert und versucht eine faktisch-stringente Erzählung aufzubauen – kann die Texte von ChatGPT und Co eigentlich nicht nutzen.

“AI tools designed to ‘imagine things’ cannot be used for journalism. Their very function means that we cannot trust them. And unless you plan to meticulously fact-check every sentence (which would not be cost-effective), none of these tools can be used by us.”

Thomas Baekdal, Media-Analyst

Die Rechnung „Ab jetzt gibt’s den ganzen guten Content kostenfrei und für immer auf Knopfdruck“ geht also nicht auf. Eingeschränkte Datenbasis, erfundene Zitate und Zitategeber:innen, fehlende Quellenangaben. Eine generative KI kann Stand 2023 nicht verifizieren, ob ihr Output sich mit unserer Realität deckt. ChatGPT und Co sind ausgeklügelte „Mixer“. Und am Ende bleibt die große Gefahr des Plagiats.

Generative KI kann ein hervorragendes Werkzeug werden – wenn wir sie überlegt einsetzen

Das soll aber nicht heißen, dass es keine sinnvollen und begründbaren Einsatzmöglichkeiten für generative KI-Tools gibt – es braucht nur entsprechende Rahmenbedingungen.

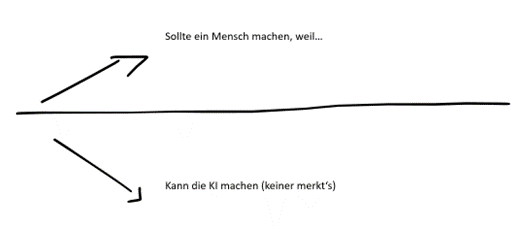

In Zukunft werden wir in der Inhaltserstellung möglicherweise eine viel stärkere Dichotomie sehen: anspruchs- oder aufmerksamkeitsarme, auch repetitive Aufgaben, die die KI abdeckt, auf der einen Seite. Und von Menschen erdachte und erstelle Inhalte mit einem besonderen Anspruch an Kreativität, Qualität und Unterscheidbarkeit auf der anderen. Dabei kann ChatGPT schon heute wertvolle Dienste leisten, wenn es um die Unterstützung von Redaktion und Co geht:

- Unterstützen bei der Recherche

- Unterstützen bei der Ideenfindung (versierter Umgang im „Prompten“ hilft!)

- Varianten für Headlines oder Teaser generieren

- Hilfe beim Finden von Synonymen oder Reimen

Fleißaufgaben innerhalb eines Recherche- oder Kreativprozesses können KI-Tools also vereinfachen oder angenehmer machen. Kreative können auf dem Output der generativen KI aufsetzen und ihre Arbeiten verfeinern; sie in technologieverliebter Manier mithilfe der künstlichen Intelligenz vielleicht sogar noch besser auf den Punkt bringen.

Bis das richtig gut funktioniert, wird es aber noch einiges an Ausprobieren aufseiten der Content-Kreator:innen (und vielleicht das eine oder andere Update an den KI-Tools) brauchen. Ob Workflows in Redaktion und Marketing sich tatsächlich verschlanken oder verbessern lassen, wird außerdem maßgeblich von den Prozessen und Rahmenbedingungen der jeweiligen Geschäftszweige und Branchen abhängen.

Content Creation mit der KI als neue Form des künstlerischen Ausdrucks?

Egal, wie wir ChatGPT, Bard und Co auf der Kommunikationsseite gegenüberstehen, entziehen können wir uns der Wirkung nicht. Und auch in weiten Teilen anderer Gesellschaftsbereiche liegen Potenzial („KI programmiert“) und Risiken („KI macht Hausarbeiten obsolet“) offen, manchmal nah beieinander.

Ebenfalls bleibt die Entwicklung der Tools selbst spannend zu beobachten. Was wird die für März 2023 angekündigte 4.0 Version von ChatGPT für Veränderungen mit sich bringen? In welchem Rahmen können verbesserte Filter und Trainings den Output der generativen Tools verbessern?

Wenn man die Zukunft bewerten möchte, lohnt sich manchmal aber auch der Blick in die Vergangenheit. Ender der 70er gab es mit dem Aufkommen des HipHop und des Samplings nämlich bereits schon einmal die Situation, dass die Grenzen zwischen Urheberschaft und Plagiat neu gesteckt wurden.

In the 70s and 80s when Hiphop started and people were sampling records, I could imagine a vast majority of people saying “well you can’t do that, that’s somebody else’s music.” And now its like, well, how creative can you sample? Pretty soon its gonna be how creative can you use the AI – the next big artists are gonna be who can prompt the best.”

Musiker Tim Henson im Interview mit YouTuber und Produzent Rick Beato

Wie sich auch die KI künftig entwickelt, es lassen sich gute Argument für einen positiven Ausblick finden: dass a) KI das Content-Business bereichern kann und b) exklusive hochwertige Arbeiten wichtiger werden – und auch mehr Erfüllung in der Erstellung bieten, als den zehntausendsten Shop-Text für die Herbsttrends 2023 zu verfassen.